Google leser fingrene dine!

human hand showing time out gesture

human hand showing time out gesture

Gestures? Vi ser for oss fektende familiemedlemmer som konkurrerer om å få TVen til å bytte kanal eller dempe lyden. En slager på CES for noen år siden som forårsaket litt moro og mye frustrasjon hos modige kunder – og forsvant fort. Nå er ‘gestures’ tilbake – i en annen form, med annet opphav og fascinerende potensiale. Hey Google!

Motivasjonen er enkel nok. Om vi er aldri så digitale, er det fortsatt naturstridig at halve verden nærmest lever via en skjerm. Ser, snakker, lytter, peker, zoomer, pincher, blar, skyver, trykker og drar. Slår på lyset, justerer volumet, leter etter programmet eller huskelappen eller presentasjonen til møtet i morgen, skifter kanal på TV eller låt på Spotify og mye mer. Bedre blir det ikke hvis vi skal ta på VR-briller – snarere tvert imot: Bortkoblet fra virkeligheten er OK for spesielle situasjoner og anvendelser, ikke som ‘the new normal’. Men hva er alternativet? Få ønsker seg tilbake til det gamle, og de som gjør det, erkjenner raskt at det ikke passer lenger. Veien går ikke bakover. Vi må videre.

Hva er så ‘videre', hva er neste trinn i en utvikling som startet med mobiltelefon og talltastatur, fortsatte med tekstmeldinger og såre tommelfingre, og deretter eksploderte med 'smarte skjermer' som vi nå bruker til alt mellom himmel og jord?

Hva er så ‘videre', hva er neste trinn i en utvikling som startet med mobiltelefon og talltastatur, fortsatte med tekstmeldinger og såre tommelfingre, og deretter eksploderte med 'smarte skjermer' som vi nå bruker til alt mellom himmel og jord?

'Gestures' sier Google. Ikke fekting, men små, naturlige fingerbevegelser. Som plukkes opp av en radar. Skepsis er første reaksjon. Dette høres naturstridig ut. Dessuten - hva med stråling? Så vekkes interessen: Mer naturstridig enn dagens ‘klistret-til-skjermen’-situasjon kan det knapt være. La oss i alle fall finne ut hva ideen er.

En artikkel via Medium.com forleden fanget vår fulle oppmerksomhet med følgende avsnitt:

In the future of the Internet of Things, touchless hand gestures are the future. They are less invasive than AR glasses like Apple and Huawei are building. They are more convenient for introverts than these Voice based Alexa or Google Home, Alibaba or Xioami devices. The future of mobile is invisible ubiquitous tech, and it’s coming faster than you think. [Google’s Project Soli is part of the future of the Internet of Things]

Fascinerende. Et knips med fingeren, en liten bevegelse, to fingre mot hverandre - ubetydelige bevegelser som ofte er naturlige i forhold til funksjonen vi ønsker. La tommelfinger gli frem og tilbake på pekefingeren og vi har en perfekt rulle-frem-og-tilbake indikasjon med god oppløsning. Eller hold tommel og pekefinger som om det ligger en skrue eller volumkontroll mellom, og vri hånden frem og tilbake. Plutselig blir det hele naturlig i stedet for merkelig, og veldig anonymt, personlig. Spesielt i forhold til skjermer, VR-briller og ‘klassisk fekting’. Og vi trenger definitivt ikke å være introverte for å se verdien av et slikt grensesnitt, spesielt på offentlige steder. Eller som enklere bruk av digitale 'armbåndsur'. Store fingre og små skjermer har aldri vært en god match.

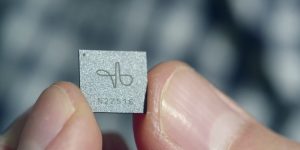

Men hvordan virker det, og hvordan skiller mekanismen mellom personer? Selve radar-teknologien er enkel nok, og fikk nylig godkjennelse for praktisk bruk av amerikanske FCC. Prosjektet har vært underveis siden 2015, og støttes av en chip - utviklet av Google - som er mindre enn et frimerke (se bildet) og har lavt energibehov. Videre - mekanismen er ‘kortholds’, så behovet for personidentifikasjon er beskjedent, i alle fall for anvendelser forskere ser for seg i dag.

Så begynner fantasien å spinne: Hvis denne lille radaren kan gjenkjenne minimale bevegelser mellom fingre, hva annet kan den brukes til? Det er blant spørsmålene forskere ved University of St. Andrews i Skottland stilte seg, og demonstrerte noen banale og mange spennende funksjoner i en interessant rapport i fjor høst. For eksempel kan Soli-radaren måle avstand, finne form og materiale, telle enheter, detektere former og posisjoner etc. – med umiddelbart anvendelsespotensiale i produksjonsmaskineri (større nøyaktighet, mye lavere kostnader enn dagens varianter) og casinoer. Fascinerende spennvidde - med et enormt potensiale imellom.

For oss er imidlertid ‘gestures’ den store interessevekkeren. En annerledes idé og en ny måte å tenke brukergrensesnitt på som allerede har fått sitt eget begrep: TUI - Tangible Users Interfaces. Og langt mer trendsettende enn første øyekast avslører. Nærmest uansett produkt - de trenger fysiske flater eller skjermer for grensesnitt. No more - med Soli. Vi aner en revolusjon – og gleder oss.

Se også ...

Legg igjen kommentar

Du må være innlogget for å kunne kommentere.